5 月 1 日消息,微軟昨日(4 月 30 日)發布 Phi-4-reasoning 系列推理模型,通過監督微調 Phi-4,并利用 o3-mini 生成的高質量“可教導”提示數據集訓練,專為復雜推理任務設計。

IT之家援引博文介紹,微軟本次共推出 Phi-4-reasoning、Phi-4-reasoning-plus 和 Phi-4-mini-reasoning 三款模型,官方稱該系列模型不僅延續了小型模型的高效特性,還在推理能力上實現重大突破。

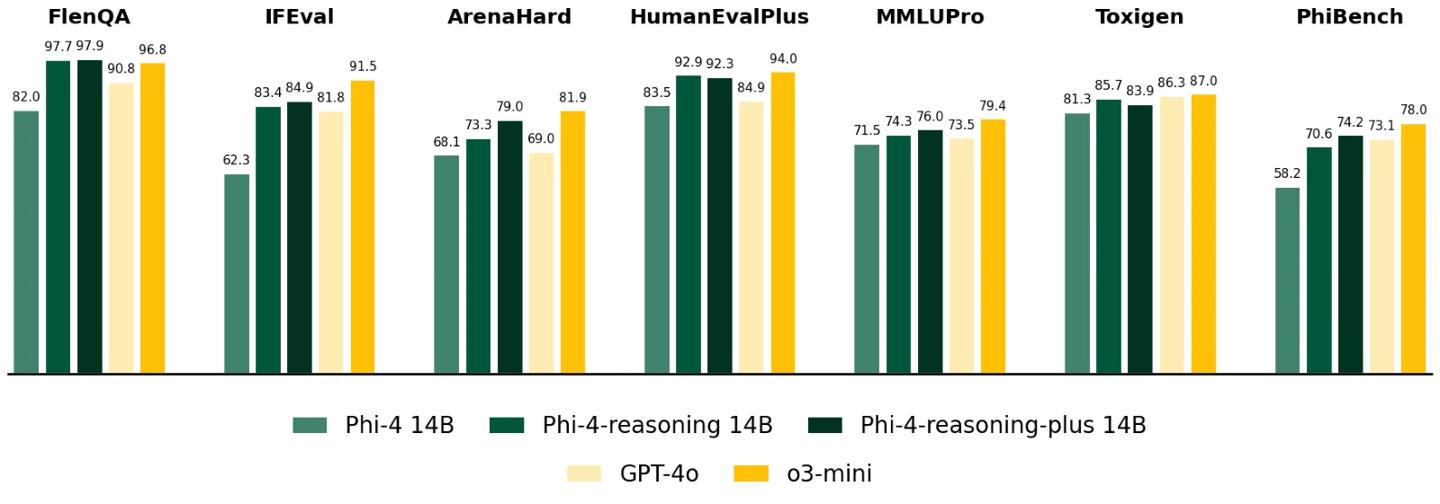

該系列模型通過推理時間擴展(inference-time scaling)技術,擅長處理需要多步驟分解和內部反思的復雜任務,尤其在數學推理和代理型應用中表現突出,具備媲美大型前沿模型的潛力。

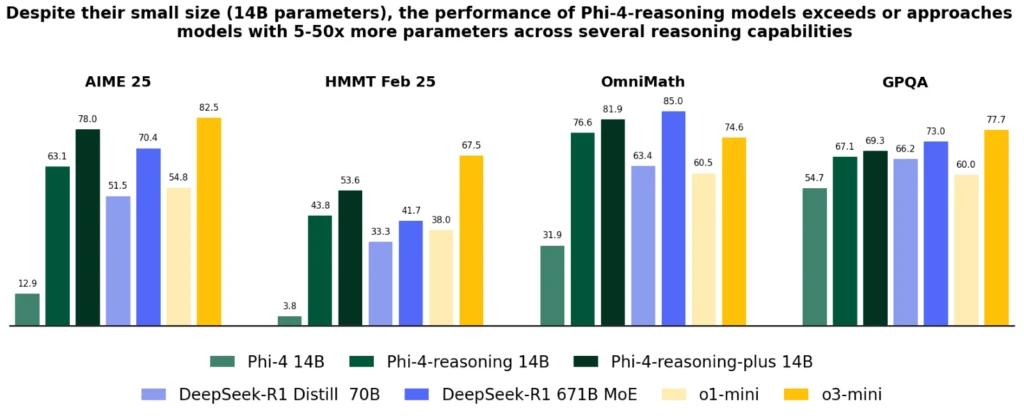

Phi-4-reasoning 是一款擁有 140 億參數的開源推理模型,通過監督微調(Supervised Fine-Tuning,SFT)Phi-4,結合 OpenAI o3-mini 的高質量推理演示數據,并充分利用額外計算資源,生成詳細的推理鏈條。

Phi-4-reasoning-plus 增強版通過強化學習(Reinforcement Learning,RL)進一步提升性能,tokens 用量比標準版多 1.5 倍,支持更高精度。

兩款模型在數學推理和博士級科學問題測試中,均超越 OpenAI o1-mini 和

DeepSeek-R1-Distill-Llama-70B,甚至在 AIME 2025(美國數學奧林匹克資格賽)中擊敗 6710 億參數的 DeepSeek-R1 滿血模型。

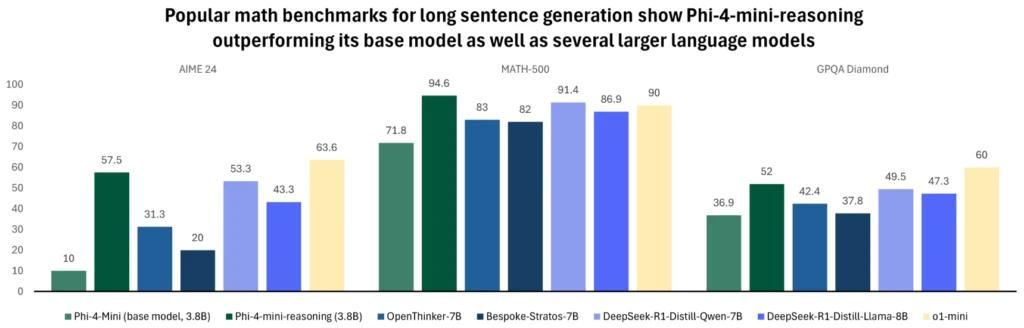

Phi-4-mini-reasoning 專為計算資源有限的環境設計,是一款基于 Transformer 的緊湊型語言模型,優化用于數學推理。